Twitter a lancé une enquête après que les utilisateurs ont affirmé que sa fonction de recadrage d’image favorisait les visages des Blancs.

Un outil automatique sur l’application mobile du réseau social recadre automatiquement les images trop grandes pour tenir sur l’écran – et sélectionne les parties d’une image à couper.

Mais une expérience d’un programmeur diplômé semble montrer des préjugés raciaux.

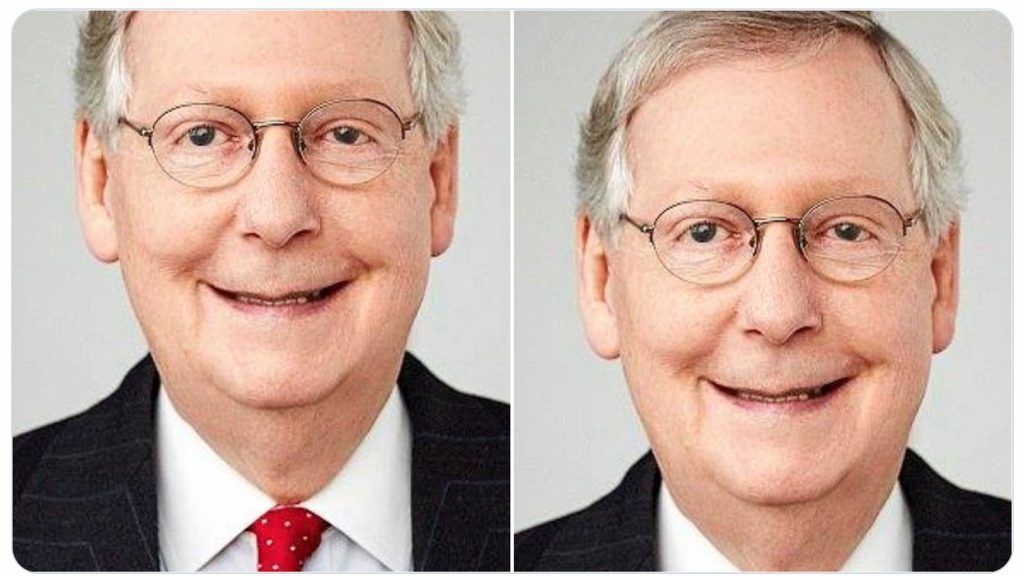

Pour voir ce que l’algorithme de Twitter choisirait, Tony Arcieri a publié une longue image montrant des tirs à la tête du chef républicain du Sénat Mitch McConnell en haut et de l’ancien président américain Barack Obama en bas – séparés par un espace blanc.

Dans une deuxième image, la photo de M. Obama a été placée en haut, avec celle de M. McConnell en bas.

Les deux fois, l’ancien président a été complètement éliminé.

À la suite de l ‘ »horrible expérience » – qui est intervenue après qu’une image qu’il a postée a rogné un collègue noir – M. Arcieri a écrit: « Twitter n’est qu’un exemple de racisme se manifestant dans les algorithmes d’apprentissage automatique. »

Au moment de la rédaction de cet article, son expérience a été retweetée 78 000 fois.

Twitter a promis de se pencher sur la question, mais a déclaré dans un communiqué: « Notre équipe a fait des tests de partialité avant d’envoyer le modèle et n’a pas trouvé de preuve de partialité raciale ou sexiste lors de nos tests.

« Il est clair à partir de ces exemples que nous avons plus d’analyses à faire. Nous continuerons à partager ce que nous apprenons, les actions que nous entreprenons, et nous ouvrirons notre analyse afin que d’autres puissent la revoir et la répliquer. »

Un représentant de Twitter a également souligné les recherches d’un scientifique de l’Université Carnegie Mellon qui a analysé 92 images. Dans cette expérience, l’algorithme a favorisé 52 fois les visages noirs.

En 2018, la société a déclaré que l’outil était basé sur un «réseau neuronal» qui utilise l’intelligence artificielle pour prédire quelle partie d’une photo serait intéressante pour un utilisateur.

Meredith Whittaker, cofondatrice de l’AI Now Institute, a déclaré à la Fondation Thomson Reuters: « Ceci est un autre exemple d’une longue et épuisante litanie d’exemples montrant des systèmes automatisés codant le racisme, la misogynie et des histoires de discrimination. »