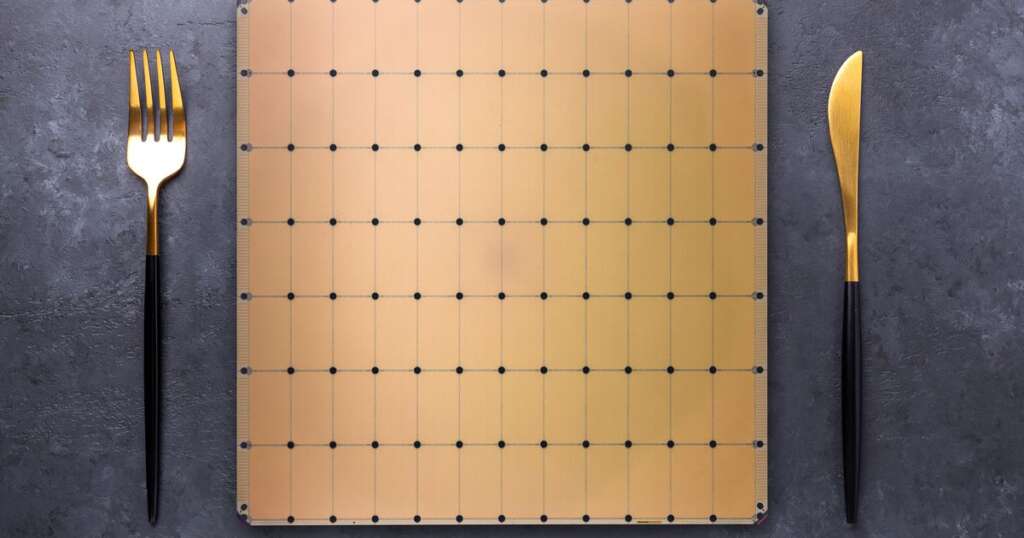

La puce accélératrice WSE-2 AI de Cerebras est constituée d’un ensemble d’éléments de processeur rectangulaires, chacun aussi gros qu’une très grande puce conventionnelle, qui occupent collectivement la majeure partie de la surface d’une plaquette de silicium entière.

Cerveaux

Une multitude d’entreprises établies et de startups naissantes se battent pour créer des puces à usage spécial afin de pousser les capacités de la technologie de l’intelligence artificielle à un nouveau niveau. Les nouvelles puces sont conçues pour aider l’IA à saisir les subtilités du langage humain et à gérer les nuances du pilotage de véhicules autonomes, comme ceux que le constructeur automobile Tesla développe.

Certaines des nouvelles puces sont énormes par rapport aux normes de l’industrie, qui valorise la miniaturisation depuis des décennies. Une puce pour l’accélération de l’IA couvre 46 225 millimètres carrés et contient 2,6 billions de transistors, le plus grand jamais selon l’estimation de son concepteur, Cerebras.

Des travaux plus conventionnels sur les puces d’IA sont en cours chez Intel, Google, Qualcomm et Apple, dont les processeurs sont conçus pour exécuter des logiciels d’IA aux côtés de nombreuses autres tâches. Mais les plus grosses puces proviennent de la puissance régnante Nvidia et d’une nouvelle génération de startups, dont Esperanto Technologies, Cerebras, GraphCore et SambaNova Systems. Leurs avancées pourraient pousser l’IA bien au-delà de son rôle actuel dans le filtrage du spam, l’édition de photos et l’alimentation des logiciels de reconnaissance faciale.

Derrière la vague de conceptions se cache l’attente que l’IA soit la prochaine ruée vers l’or technologique. Les systèmes d’IA, qui fonctionnent en imitant des aspects du cerveau humain, s’améliorent rapidement en matière de reconnaissance de formes et de prise de décision. Parce qu’il a le potentiel de lutter contre la complexité du monde réel, des entreprises comme Tesla et Skydio, un fabricant de drones, parient que l’IA laissera leurs véhicules se piloter eux-mêmes.

Les startups de puces ont dévoilé leurs conceptions lors de la conférence Hot Chips plus tôt cette semaine. La conférence a eu lieu juste après que Tesla ait détaillé son ambitieuse technologie de formation Dojo AI et le processeur D1 en son cœur. Lors de cet événement de la Journée de l’IA, le directeur général de Tesla, Elon Musk, a déclaré que la technologie de l’IA est assez bonne même pour aider un robot humanoïde, le Tesla Bot, à naviguer dans le monde réel.

Une IA plus puissante signifie des avancées qui ne sont pas freinées par le lent processus de formation à l’IA. Le GPT-3 d’Open AI, un système d’IA de haut niveau pour générer du texte lisible par l’homme, a pris quatre mois pour se former.

Puces d’IA énormes

Les tâches informatiques quotidiennes, telles que la vérification de vos e-mails ou la diffusion en continu d’une vidéo, impliquent principalement une seule tâche informatique, appelée fil. La formation d’un modèle d’IA, cependant, nécessite un système capable de gérer beaucoup plus de threads à la fois.

« Les charges de travail d’IA fonctionnent mieux avec un parallélisme massif », a déclaré James Sanders, analyste du 451 Group. C’est pourquoi les processeurs d’accélération de l’IA sont parmi les plus importants du secteur.

La carte accélératrice à trois processeurs d’Esperanto Technologies se branche dans l’emplacement d’extension PCIe d’un serveur.

Technologies de l’espéranto

À peu près tous les processeurs que vous avez utilisés, que ce soit dans votre téléphone ou en regardant une vidéo Netflix, étaient à l’origine parmi de nombreux processeurs découpés dans une plaquette circulaire de cristal de silicium de 300 mm de diamètre, soit environ 12 pouces. Plus la puce est grosse, moins il y a de place sur une plaquette et plus elle est chère à fabriquer, en partie parce qu’il est plus probable qu’un défaut de la taille d’un point puisse ruiner une unité entière. Les processeurs à usage général typiques ont des milliards de transistors. Par exemple, le processeur A14 de l’iPhone 12 d’Apple mesure 88 millimètres carrés et abrite 11,8 milliards de transistors.

Les puces AI, personnalisées pour les besoins particuliers des algorithmes et des données AI, commencent à partir des mêmes plaquettes de 300 mm que les autres processeurs, mais finissent par être à peu près les plus grandes du secteur.

Le processeur ET-SOC-1 d’Esperanto mesure 570 millimètres carrés avec 24 milliards de transistors, a déclaré le co-fondateur Dave Ditzel à Hot Chips. Le processeur D1 de Tesla, la base du système de formation Dojo AI qu’il vient de commencer à construire, mesure 645 millimètres carrés avec 50 milliards de transistors, a déclaré le chef du Dojo, Ganesh Venkataramanan. Colossus Mk2 de Graphcore à 823 millimètres carrés et 59 milliards de transistors.

Encore plus gros : la puce Cerebras AI

Cerebras est encore dans une autre catégorie pour la taille des puces.

Là où les processeurs ordinaires sont coupés par dizaines ou centaines dans une plaquette de 300 mm, Cerebras conserve la plaquette complète intacte pour créer un seul processeur accélérateur WSE-2 AI. L’équipement de fabrication de puces ne peut graver des circuits de transistors que sur une zone rectangulaire relativement petite de la plaquette à la fois. Mais Cerebras conçoit chacun de ces éléments de puce rectangulaires afin qu’ils puissent communiquer entre eux à travers la plaquette.

Le résultat : un processeur à transistors de 2 600 milliards couvrant 46 225 millimètres carrés – presque exactement la même surface qu’un iPad Pro 11 pouces, bien que de forme plus carrée. Fait intéressant, la société a utilisé le logiciel d’IA de la société de conception de puces Synopsys pour optimiser ses propres circuits de puces d’IA.

D’autres sociétés de puces IA relient également leurs puces entre elles – le Dojo de Tesla regroupera 3 000 puces D1 en une seule unité qu’il appelle un Exapod. Mais la puce de Cerebras va encore plus loin dans l’intégration.

Cerebras compte parmi ses clients le géant pharmaceutique GlaxoSmithKline et le centre de calcul intensif Argonne National Laboratory. Le SWE-2 est le processeur de deuxième génération de l’entreprise.

AI tech : formation et inférence

Les informaticiens ont essayé pendant des décennies de développer l’IA, mais ont été bloqués par les limitations du matériel et des logiciels. Les progrès technologiques, cependant, ont rendu l’idée pratique. L’IA fait généralement référence à une technologie d’apprentissage automatique appelée réseaux de neurones, qui est vaguement basée sur nos propres milliards de cellules cérébrales interconnectées.

C’est une technologie en deux étapes. Initialement, un réseau de neurones apprend à repérer des modèles dans des ensembles extrêmement volumineux de données soigneusement annotées, telles que des photos étiquetées ou des enregistrements vocaux accompagnés de transcriptions précises. La formation bénéficie d’un matériel informatique extrêmement puissant.

Le processeur Telum des derniers mainframes d’IBM, sans doute la conception de serveur la plus conservatrice du secteur, dispose de circuits pour booster les logiciels d’IA.

IBM

La deuxième phase utilise le modèle qui a été créé, une tâche appelée inférence, et l’applique au nouveau matériel. Par exemple, l’IA pourrait être invitée à reconnaître l’écriture manuscrite ou à repérer les e-mails de phishing malveillants. Sur le plan informatique, l’inférence est une tâche beaucoup moins difficile, bien qu’elle bénéficie toujours de l’accélération. Une partie de cela se produit sur les puces Apple, Qualcomm, Intel et d’autres conçues pour les appareils grand public, et certaines dans les centres de données tentaculaires « hyperscale » qui utilisent des milliers de serveurs pour des services Internet géants comme YouTube et Facebook.

« Les hyperscalers – des endroits comme Facebook et Amazon – bénéficient vraiment énormément de l’IA », ce qui les aide à suggérer plus intelligemment les publications que vous pourriez vouloir voir ou les produits que vous pourriez vouloir acheter, a déclaré Nathan Brookwood, analyste chez Insight 64.

Les défis de la puce IA

Construire des puces d’accélération d’IA n’est pas facile. Intel a mis au rebut Nervana, sa première puce d’IA. La start-up Wave Computing a déposé une demande de mise en faillite en 2020, émergeant cette année avec une tentative d’entreprise de licence de puces plus ordinaire.

Et la technologie en place pour la formation des systèmes d’IA, des puces graphiques haut de gamme, reste puissante. Le système de formation à l’IA actuel de Tesla utilise par exemple les puces graphiques de Nvidia.

L’architecte informatique de Nvidia, Ritika Borkar, a déclaré dans un fil Twitter que la flexibilité des puces graphiques aide l’entreprise à faire face à des cycles plus courts en IA, un domaine où les techniques changent environ tous les 18 mois.